Testează-ți AFACEREA în Minute

Creează-ți contul și lansează-ți chatbot-ul AI în câteva minute. Complet personalizabil, fără necesitatea de a programa - începe să interacționezi cu clienții tăi instantaneu!

Magia din spatele ferestrei de chat

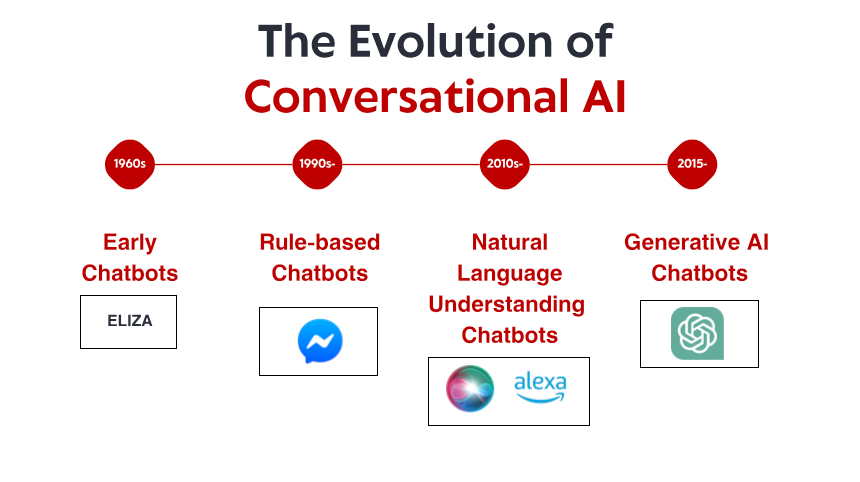

Simplitatea aparentă a chatboților moderni maschează o orchestră tehnologică incredibil de sofisticată care cântă în culise. Ceea ce pare a fi un simplu schimb de text implică mai multe sisteme specializate de inteligență artificială care lucrează concertat: procesarea limbajului tău, recuperarea informațiilor relevante, generarea de răspunsuri adecvate și învățarea constantă din interacțiuni.

Ca cineva care a petrecut ani de zile dezvoltând și implementând sisteme de chatbot pentru diverse industrii, am fost în primul rând la evoluția lor remarcabilă. Mulți utilizatori sunt surprinși să afle că chatboții moderni nu sunt programe de inteligență artificială singulare, ci mai degrabă ecosisteme complexe de componente specializate care lucrează împreună. Înțelegerea acestor componente nu numai că demitizează ceea ce poate părea uneori magie tehnologică, dar ne ajută și să apreciem mai bine atât capacitățile, cât și limitele lor.

În această explorare, vom trage cortina asupra chatbot-urilor moderne pentru a înțelege tehnologiile cheie care le alimentează, modul în care sunt antrenate aceste sisteme și cum depășesc provocările fundamentale ale limbajului uman. Indiferent dacă vă gândiți să implementați un chatbot pentru afacerea dvs. sau pur și simplu sunteți curioși în legătură cu tehnologia cu care interacționați zilnic, acest tur din culise vă va oferi informații valoroase despre una dintre cele mai vizibile aplicații ale inteligenței artificiale.

Fundația: Modele lingvistice mari

Amploarea acestor modele este dificil de înțeles. Cele mai mari LLM au sute de miliarde de parametri - valorile ajustabile pe care modelul le folosește pentru a face predicții. În timpul antrenamentului, acești parametri sunt rafinați treptat, pe măsură ce modelul procesează seturi de date masive constând din cărți, articole, site-uri web, depozite de cod și alte texte - adesea însumând trilioane de cuvinte.

Prin acest proces de antrenament, modelele lingvistice dezvoltă o înțelegere statistică a modului în care funcționează limbajul. Ele învață vocabular, gramatică, informații despre lume, modele de raționament și chiar un anumit grad de bun simț. Este important de menționat că nu își memorează pur și simplu datele de antrenament - ele învață modele generalizabile care le permit să gestioneze noi intrări pe care nu le-au mai văzut niciodată.

Când trimiteți un mesaj către un chatbot alimentat de un LLM, textul dvs. este mai întâi convertit în reprezentări numerice numite token-uri. Modelul procesează aceste token-uri prin numeroasele sale straturi de conexiuni neuronale, producând în cele din urmă distribuții de probabilitate pentru ce token-uri ar trebui să apară în continuare într-un răspuns. Sistemul convertește apoi aceste token-uri înapoi în text lizibil de om.

Cele mai avansate modele lingvistice de astăzi includ:

GPT-4: Modelul OpenAI stă la baza ChatGPT și a multor alte aplicații comerciale, cunoscut pentru capacitățile sale puternice de raționament și cunoștințele vaste.

Claude: Familia de modele Anthropic, concepută cu accent pe ajutor, inofensivitate și onestitate.

Llama 3: Modelele open-weight de la Meta, care au democratizat accesul la tehnologia LLM puternică.

Gemini: Modelele multimodale de la Google care pot procesa atât text, cât și imagini.

Mistral: O familie de modele eficiente care oferă performanțe impresionante în ciuda numărului mai mic de parametri.

În ciuda capacităților lor remarcabile, modelele lingvistice de bază au singure limitări semnificative ca agenți conversaționali. Nu au acces la informații în timp real, nu pot căuta pe web sau în bazele de date pentru a verifica faptele și adesea „halucinează” – generând informații care par plauzibile, dar incorecte. În plus, fără personalizare suplimentară, le lipsesc cunoștințele despre afaceri, produse sau contexte specifice ale utilizatorilor.

De aceea, arhitecturile moderne ale chatbot-urilor integrează sistemele de învățare în timp real (LLM) cu alte componente cruciale pentru a crea sisteme conversaționale cu adevărat utile.

Generație augmentată prin recuperare: Ancorarea chatboților la fapte

Sistemele RAG funcționează prin combinarea capacităților generative ale modelelor lingvistice cu precizia sistemelor de recuperare a informațiilor. Iată cum decurge un proces RAG tipic într-un chatbot modern:

Procesarea interogărilor: Când un utilizator pune o întrebare, sistemul o analizează pentru a identifica nevoile cheie de informații.

Recuperarea informațiilor: În loc să se bazeze exclusiv pe datele de antrenament ale LLM, sistemul caută în bazele de cunoștințe relevante - care pot include documentația companiei, cataloage de produse, întrebări frecvente sau chiar conținutul live al unui site web.

Selecția documentelor relevante: Sistemul de recuperare identifică cele mai relevante documente sau pasaje pe baza similarității semantice cu interogarea.

Augmentarea contextului: Aceste documente recuperate sunt furnizate modelului lingvistic ca context suplimentar atunci când se generează răspunsul său.

Generarea de răspunsuri: LLM produce un răspuns care încorporează atât capacitățile sale lingvistice generale, cât și informațiile specifice recuperate.

Atribuirea sursei: Multe sisteme RAG urmăresc, de asemenea, sursele care au contribuit la răspuns, permițând citarea sau verificarea.

Această abordare combină ce e mai bun din ambele lumi: capacitatea LLM de a înțelege întrebările și de a genera limbaj natural, cu acuratețea și informațiile actualizate din sistemele de recuperare. Rezultatul este un chatbot care poate oferi informații specifice, factuale despre produse, politici sau servicii fără a recurge la halucinații.

Luați în considerare un chatbot de serviciu clienți pentru comerț electronic. Atunci când este întrebat despre politicile de returnare pentru un anumit produs, un LLM pur ar putea genera un răspuns plauzibil, dar potențial incorect, bazat pe modele generale observate în timpul antrenamentului. Un chatbot îmbunătățit cu RAG ar recupera în schimb documentul real al politicii de returnare a companiei, ar găsi secțiunea relevantă despre acea categorie de produse și ar genera un răspuns care reflectă cu acuratețe politica actuală.

Sofisticarea sistemelor RAG continuă să avanseze. Implementările moderne utilizează încorporări vectoriale dense pentru a reprezenta atât interogări, cât și documente în spațiu semantic de înaltă dimensionalitate, permițând recuperarea bazată pe semnificație, mai degrabă decât doar pe potrivirea cuvintelor cheie. Unele sisteme utilizează conducte de recuperare în mai multe etape, mai întâi proiectând o rețea largă și apoi rafinând rezultatele prin reclasificare. Altele determină dinamic când este necesară recuperarea față de când LLM poate răspunde în siguranță pe baza cunoștințelor sale parametrice.

Pentru companiile care implementează chatbot-uri, implementarea eficientă a RAG necesită o pregătire atentă a bazei de cunoștințe - organizarea informațiilor în blocuri recuperabile, actualizarea regulată a conținutului și structurarea datelor în moduri care facilitează recuperarea precisă. Atunci când este implementat corect, RAG îmbunătățește dramatic acuratețea chatbot-urilor, în special pentru aplicațiile specifice domeniului în care precizia este crucială.

Gestionarea stării conversaționale: menținerea contextului

Chatboții moderni utilizează sisteme sofisticate de gestionare a stării conversaționale pentru a menține schimburi coerente și contextuale. Aceste sisteme urmăresc nu doar conținutul explicit al mesajelor, ci și contextul implicit pe care oamenii îl mențin în mod natural în timpul conversațiilor.

Cea mai elementară formă de gestionare a stării este urmărirea istoricului conversațiilor. Sistemul menține un buffer al schimburilor recente (atât intrări ale utilizatorului, cât și propriile răspunsuri) care este furnizat modelului lingvistic cu fiecare interogare nouă. Cu toate acestea, pe măsură ce conversațiile devin mai lungi, includerea întregului istoric devine impracticabilă din cauza limitărilor de lungime a contextului chiar și ale celor mai avansate LLM-uri.

Pentru a aborda această constrângere, chatboții sofisticați utilizează mai multe tehnici:

Rezumatizare: Condensarea periodică a părților anterioare ale conversației în rezumate concise care captează informații cheie, reducând în același timp utilizarea token-urilor.

Urmărirea entităților: Monitorizarea explicită a entităților importante (persoane, produse, probleme) menționate pe parcursul conversației și menținerea lor într-o stare structurată.

Conștientizarea etapei conversației: Urmărirea locului în care se află conversația în fluxul unui proces - fie că este vorba de colectarea de informații, propunerea de soluții sau confirmarea acțiunilor.

Persistența contextului utilizatorului: Menținerea informațiilor relevante despre utilizator de-a lungul sesiunilor, cum ar fi preferințele, istoricul achizițiilor sau detaliile contului (cu controale de confidențialitate adecvate).

Memoria intenției: Reținerea obiectivului inițial al utilizatorului chiar și prin ocolișuri și clarificări ale conversației.

Luați în considerare un scenariu de serviciu clienți: Un utilizator începe să întrebe despre actualizarea planului său de abonament, apoi pune mai multe întrebări detaliate despre caracteristici, comparații de prețuri și cicluri de facturare, înainte de a decide în final să continue cu actualizarea. Un sistem eficient de gestionare a stării conversaționale asigură că, atunci când utilizatorul spune „Da, hai să o facem”, chatbot-ul înțelege exact la ce se referă „aceasta” (actualizarea) și a păstrat toate detaliile relevante din conversația sinuoasă.

Implementarea tehnică a gestionării stării variază în funcție de platformă. Unele sisteme utilizează o abordare hibridă, combinând urmărirea simbolică a stării (modelând explicit entitățile și intențiile) cu capacitățile implicite ale ferestrelor contextuale mari din LLM-urile moderne. Altele utilizează module de memorie specializate care preiau selectiv părți relevante din istoricul conversațiilor pe baza interogării curente.

Pentru aplicații complexe precum serviciul clienți sau vânzările, gestionarea stării se integrează adesea cu modelarea proceselor de afaceri, permițând chatbot-urilor să ghideze conversațiile prin fluxuri de lucru definite, menținând în același timp flexibilitatea pentru interacțiunea naturală. Cele mai avansate implementări pot chiar urmări starea emoțională alături de contextul factual, ajustând stilul de comunicare pe baza sentimentului detectat al utilizatorului.

Gestionarea eficientă a contextului transformă interacțiunile chatbot-urilor din schimburi de întrebări-răspunsuri deconectate în conversații autentice care se bazează pe o înțelegere comună - un factor critic în satisfacția utilizatorilor și ratele de finalizare a sarcinilor.

Înțelegerea limbajului natural: Interpretarea intenției utilizatorului

Sistemele NLU moderne din chatboții îndeplinesc de obicei mai multe funcții cheie:

Recunoașterea intenției: Identificarea obiectivului sau scopului fundamental al utilizatorului. Încearcă utilizatorul să facă o achiziție, să raporteze o problemă, să solicite informații sau altceva? Sistemele avansate pot recunoaște intenții multiple sau imbricate într-un singur mesaj.

Extragerea entităților: Identificarea și clasificarea anumitor informații din mesajul utilizatorului. De exemplu, în „Trebuie să-mi schimb zborul de la Chicago la Boston joi”, entitățile includ locații (Chicago, Boston) și ora (joi).

Analiza sentimentelor: Detectarea tonului emoțional și a atitudinii, ceea ce ajută chatbot-ul să-și ajusteze stilul de răspuns în mod corespunzător. Este utilizatorul frustrat, entuziasmat, confuz sau neutru? Identificarea limbii: Determinarea limbii pe care o vorbește utilizatorul pentru a oferi răspunsuri adecvate în medii multilingve.

În timp ce platformele chatbot anterioare necesitau programarea explicită a intențiilor și entităților, sistemele moderne valorifică capacitățile inerente de înțelegere a limbajului ale LLM-urilor. Acest lucru le permite să gestioneze o gamă mult mai largă de expresii fără a necesita o enumerare exhaustivă a posibilelor formulări.

Când un utilizator tastează „Procesul de finalizare a comenzii se blochează în continuare pe pagina de plată”, un sistem NLU sofisticat ar identifica acest lucru ca o intenție de asistență tehnică, ar extrage „procesul de finalizare a comenzii” și „pagina de plată” ca entități relevante, ar detecta frustrarea din sentiment și ar direcționa aceste informații către calea de generare a răspunsurilor corespunzătoare.

Acuratețea NLU are un impact semnificativ asupra satisfacției utilizatorului. Atunci când un chatbot interpretează greșit în mod constant solicitările, utilizatorii își pierd rapid încrederea și răbdarea. Pentru a îmbunătăți acuratețea, multe sisteme utilizează scorarea încrederii - atunci când încrederea în înțelegere scade sub anumite praguri, chatbot-ul poate pune întrebări de clarificare, în loc să continue cu presupuneri potențial incorecte.

Pentru aplicații specifice domeniului, sistemele NLU încorporează adesea terminologie specializată și recunoașterea jargonului. Un chatbot din domeniul sănătății, de exemplu, ar fi instruit să recunoască termenii și simptomele medicale, în timp ce un bot din domeniul serviciilor financiare ar înțelege terminologia bancară și tipurile de tranzacții.

Integrarea NLU cu celelalte componente este crucială. Intențiile și entitățile extrase informează procesele de recuperare, ajută la menținerea stării conversaționale și ghidează generarea de răspunsuri - servind drept legătură critică între ceea ce spun utilizatorii și ceea ce face sistemul.

Testează-ți AFACEREA în Minute

Creează-ți contul și lansează-ți chatbot-ul AI în câteva minute. Complet personalizabil, fără necesitatea de a programa - începe să interacționezi cu clienții tăi instantaneu!

Generarea și optimizarea răspunsurilor

În sistemele moderne, generarea răspunsurilor implică de obicei mai multe etape:

Planificarea răspunsurilor: Determinarea informațiilor care trebuie incluse, a întrebărilor care trebuie puse sau a acțiunilor care trebuie sugerate pe baza stării actuale a conversației și a cunoștințelor disponibile.

Selecția conținutului: Alegerea faptelor, explicațiilor sau opțiunilor specifice care trebuie prezentate din seturi potențial mari de informații relevante.

Structurare: Organizarea conținutului selectat într-o secvență logică, ușor de urmărit, care răspunde eficient nevoilor utilizatorului.

Realizare: Conversia conținutului planificat într-un limbaj natural, fluent, care se potrivește cu tonul și stilul dorite ale chatbotului.

Deși Generarea Limbajului Natural poate genera un text impresionant de coerent, generarea necontrolată duce adesea la probleme precum verbositatea excesivă, includerea de informații irelevante sau răspunsuri care nu se aliniază cu obiectivele de afaceri. Pentru a aborda aceste probleme, sistemele sofisticate de chatbot implementează diverse tehnici de optimizare:

Șabloane de răspuns: Pentru scenarii comune cu nevoi informaționale previzibile, multe sisteme utilizează șabloane parametrizate care asigură răspunsuri consecvente și eficiente, permițând în același timp personalizarea.

Controlul lungimii: Mecanisme de ajustare a lungimii răspunsului în funcție de complexitatea interogării, platforma pe care are loc interacțiunea și preferințele utilizatorului.

Îndrumare privind tonul și stilul: Instrucțiuni care ajustează formalitatea, prietenozitatea sau nivelul tehnic al răspunsurilor în funcție de contextul conversației și de caracteristicile utilizatorului.

Planificarea pe mai multe ture: Pentru subiecte complexe, sistemele pot planifica răspunsuri pe mai multe ture, împarțind intenționat informațiile în bucăți ușor de digerat, mai degrabă decât să copleșească utilizatorii cu ziduri de text.

Integrarea logicii de business: Reguli care asigură că răspunsurile se aliniază cu politicile de afaceri, cerințele de reglementare și capacitățile serviciilor.

Cei mai eficienți chatbots utilizează, de asemenea, strategii de răspuns adaptive. Aceștia monitorizează semnalele de implicare și satisfacție a utilizatorilor pentru a-și rafina abordarea de comunicare în timp. Dacă utilizatorii solicită frecvent clarificări după un anumit tip de răspuns, sistemul s-ar putea ajusta automat pentru a oferi explicații mai detaliate în scenarii viitoare similare.

Un aspect crucial al generării de răspunsuri este gestionarea incertitudinii. Când informațiile nu sunt disponibile sau sunt ambigue, sistemele bine concepute își recunosc limitele, în loc să genereze răspunsuri care par sigure, dar potențial incorecte. Această transparență construiește încredere și gestionează eficient așteptările utilizatorilor.

Pentru aplicațiile critice, cum ar fi cele din domeniul sănătății sau al serviciilor financiare, multe implementări includ mecanisme de revizuire umană pentru anumite tipuri de răspunsuri înainte ca acestea să ajungă la utilizatori. Aceste bariere oferă un nivel suplimentar de control al calității pentru interacțiunile cu miză mare.

Module specializate pentru acțiuni și integrare

Aceste capacități de acțiune sunt implementate prin module specializate care conectează interfața conversațională cu sisteme externe:

Cadrul de integrare API: Un strat middleware care traduce cererile conversaționale în apeluri API formatate corect către diverse servicii backend – sisteme de comandă, platforme CRM, procesatoare de plăți, sisteme de rezervare etc.

Autentificare și autorizare: Componente de securitate care verifică identitatea utilizatorului și nivelurile de permisiune înainte de a efectua acțiuni sensibile sau de a accesa informații protejate.

Asistență la completarea formularelor: Module care ajută utilizatorii să completeze formulare complexe prin interacțiune conversațională, colectând informațiile necesare bucată cu bucată, în loc să prezinte formulare copleșitoare.

Procesarea tranzacțiilor: Componente care gestionează procese în mai mulți pași, cum ar fi achiziții, rezervări sau modificări de cont, menținând starea pe tot parcursul procesului și gestionând excepțiile cu eleganță.

Sisteme de notificare: Capacități de a trimite actualizări, confirmări sau alerte prin diverse canale (e-mail, SMS, notificări în aplicație) pe măsură ce acțiunile progresează sau se finalizează.

Sofisticitatea acestor integrări variază foarte mult în funcție de implementare. Chatbot-urile simple pot include funcționalități de bază de „predare” care transferă utilizatorii către agenți umani sau sisteme specializate atunci când este necesară o acțiune. Implementările mai avansate oferă experiențe end-to-end fără probleme, în care chatbot-ul gestionează întregul proces din cadrul conversației.

Luați în considerare un chatbot al unei companii aeriene care ajută un pasager să schimbe un zbor. Acesta trebuie să:

Autentifice utilizatorul și să recupereze rezervarea acestuia

Caute zboruri alternative disponibile

Calculeze orice diferențe de tarif sau taxe de modificare

Proceseze plata, dacă este necesar

Emită noi cărți de îmbarcare

Actualizeze rezervarea în mai multe sisteme

Trimită detalii de confirmare prin canalele preferate

Realizarea acestui lucru necesită integrare cu sisteme de rezervare, procesatoare de plăți, servicii de autentificare și platforme de notificare - toate orchestrate de chatbot, menținând în același timp un flux natural de conversație.

Pentru companiile care construiesc chatbot-uri orientate spre acțiune, acest strat de integrare reprezintă adesea cel mai substanțial efort de dezvoltare. Deși componentele conversaționale beneficiază de progresele înregistrate în domeniul inteligenței artificiale de uz general, aceste integrări trebuie să fie personalizate pentru peisajul specific al sistemelor fiecărei organizații.

Considerațiile de securitate sunt deosebit de importante pentru chatboții capabili de acțiune. Cele mai bune practici includ implementarea unei autentificări adecvate înainte de operațiunile sensibile, menținerea unor jurnale de audit detaliate ale tuturor acțiunilor întreprinse, furnizarea unor pași clari de confirmare pentru activitățile ulterioare și proiectarea unei gestionări elegante a erorilor atunci când integrările întâmpină probleme.

Pe măsură ce aceste capacități de integrare avansează, granița dintre interfețele conversaționale și aplicațiile tradiționale continuă să se estompeze. Cele mai sofisticate implementări de astăzi permit utilizatorilor să îndeplinească sarcini complexe în întregime prin conversații naturale, care anterior ar fi necesitat navigarea pe mai multe ecrane în aplicațiile tradiționale.

Instruire și îmbunătățire continuă

Mai multe abordări ale instruirii și îmbunătățirii funcționează împreună:

Reglarea fină a modelului de bază: Modelele de limbaj de bază care alimentează chatboții pot fi specializate în continuare prin instruire suplimentară pe date specifice domeniului. Acest proces, numit reglare fină, ajută modelul să adopte terminologia, modelele de raționament și cunoștințele de domeniu adecvate pentru aplicații specifice.

Învățarea prin consolidare din feedback-ul uman (RLHF): Această tehnică utilizează evaluatori umani pentru a evalua răspunsurile modelului, creând date despre preferințe care antrenează modele de recompensă. Aceste modele de recompensă ghidează apoi sistemul către generarea de rezultate mai utile, precise și sigure. RLHF a fost crucial în transformarea modelelor de limbaj de la generatoare impresionante, dar nesigure, la asistenți practici.

Extragerea conversațiilor: Sisteme de analiză care procesează jurnale de conversație anonimizate pentru a identifica modele, întrebări comune, puncte de eșec frecvente și căi de rezolvare cu succes. Aceste informații conduc atât la îmbunătățiri automate, cât și la rafinări conduse de oameni.

Învățare activă: Sisteme care identifică zonele de incertitudine și semnalează aceste instanțe pentru revizuire umană, concentrând efortul uman asupra celor mai valoroase oportunități de îmbunătățire.

Testare A/B: Cadre experimentale care compară diferite strategii de răspuns cu utilizatori reali pentru a determina care abordări sunt cele mai eficiente pentru diverse scenarii.

Pentru chatboții din întreprinderi, procesul de instruire începe de obicei cu date istorice - transcrieri anterioare ale serviciului clienți, documentație și informații despre produse. Această instruire inițială este apoi completată cu exemple de conversații atent concepute, care demonstrează gestionarea ideală a scenariilor comune.

Odată implementate, sistemele eficiente includ mecanisme de feedback care permit utilizatorilor să indice dacă răspunsurile au fost utile. Acest feedback, combinat cu semnale implicite, cum ar fi abandonarea conversației sau întrebări repetate, creează un set de date bogat pentru îmbunătățirea continuă.

Rolul uman în instruirea chatboților moderni rămâne esențial. Designerii de conversații creează modelele de bază de personalitate și comunicare. Experții în domeniu revizuiesc și corectează răspunsurile propuse pentru acuratețe tehnică. Oamenii de știință în domeniul datelor analizează indicatorii de performanță pentru a identifica oportunitățile de îmbunătățire. Cele mai reușite implementări tratează dezvoltarea chatboților ca un parteneriat colaborativ om-IA, mai degrabă decât ca un proces complet automatizat.

Pentru companiile care implementează chatboți, stabilirea unui cadru clar de îmbunătățire este esențială. Aceasta include:

Cicluri regulate de evaluare a performanței

Personal dedicat pentru monitorizare și rafinare

Metrici clare pentru succes

Procese pentru încorporarea feedback-ului utilizatorilor

Guvernanță pentru gestionarea calității datelor de instruire

Deși abordările specifice variază în funcție de platforme și aplicații, principiul fundamental rămâne consistent: chatboții moderni sunt sisteme dinamice care se îmbunătățesc prin utilizare, feedback și rafinare deliberată, mai degrabă decât programe statice blocate în capacitățile lor inițiale.

Măsuri de siguranță și considerații etice

These safeguards typically include:

Content Filtering: Systems that detect and prevent harmful, offensive, or inappropriate content in both user inputs and model outputs. Modern implementations use specialized models specifically trained to identify problematic content across various categories.

Scope Enforcement: Mechanisms that keep conversations within appropriate domains, preventing chatbots from being manipulated into providing advice or information outside their intended purpose and expertise.

Data Privacy Controls: Protections for sensitive user information, including data minimization principles, anonymization techniques, and explicit consent mechanisms for data storage or usage.

Bias Mitigation: Processes that identify and reduce unfair biases in training data and model outputs, ensuring equitable treatment across different user groups.

External Reference Verification: For factual claims, particularly in sensitive domains, systems that verify information against trusted external sources before presenting it to users.

Human Oversight: For critical applications, review mechanisms that enable human monitoring and intervention when necessary, particularly for consequential decisions or sensitive topics.

The implementation of these safeguards involves both technical and policy components. At the technical level, various filtering models, detection algorithms, and monitoring systems work together to identify problematic interactions. At the policy level, clear guidelines define appropriate use cases, required disclaimers, and escalation paths.

Healthcare chatbots provide a clear example of these principles in action. Well-designed systems in this domain typically include explicit disclaimers about their limitations, avoid diagnostic language unless medically validated, maintain strict privacy controls for health information, and include clear escalation paths to human medical professionals for appropriate concerns.

For businesses implementing chatbots, several best practices have emerged:

Start with clear ethical guidelines and use case boundaries

Implement multiple layers of safety mechanisms rather than relying on a single approach

Test extensively with diverse user groups and scenarios

Establish monitoring and incident response protocols

Provide transparent information to users about the system's capabilities and limitations

As conversational AI becomes more powerful, the importance of these safeguards only increases. The most successful implementations balance innovation with responsibility, ensuring that chatbots remain helpful tools that enhance human capabilities rather than creating new risks or harms.

The Future of Chatbot Technology

While today's chatbots have come remarkably far from their primitive ancestors, the technology continues to evolve rapidly. Several emerging trends indicate where conversational AI is headed in the near future:

Multimodal Capabilities: The next generation of chatbots will move beyond text to seamlessly incorporate images, voice, video, and interactive elements. Users will be able to show problems through their camera, hear explanations with visual aids, and interact through whatever medium is most convenient for their current context.

Agentic Behaviors: Advanced chatbots are moving from reactive question-answering to proactive problem-solving. These "agentic" systems can take initiative, break complex tasks into steps, use tools to gather information, and persist until objectives are achieved – more like virtual assistants than simple chatbots.

Memory and Personalization: Future systems will maintain more sophisticated long-term memory of user preferences, past interactions, and relationship history. This persistent understanding will enable increasingly personalized experiences that adapt to individual communication styles, knowledge levels, and needs.

Specialized Domain Experts: While general-purpose chatbots will continue to improve, we're also seeing the emergence of highly specialized systems with deep expertise in specific domains – legal assistants with comprehensive knowledge of case law, medical systems trained on clinical literature, or financial advisors versed in tax codes and regulations.

Collaborative Intelligence: The line between human and AI responsibilities will continue to blur, with more sophisticated collaboration models where chatbots and human experts work together seamlessly, each handling aspects of customer interaction where they excel.

Emotional Intelligence: Advancements in affect recognition and appropriate emotional response generation will create more naturally empathetic interactions. Future systems will better recognize subtle emotional cues and respond with appropriate sensitivity to user needs.

Federated and On-Device Processing: Privacy concerns are driving development of architectures where more processing happens locally on user devices, with less data transmitted to central servers. This approach promises better privacy protection while maintaining sophisticated capabilities.

These advancements will enable new applications across industries. In healthcare, chatbots may serve as continuous health companions, monitoring conditions and coordinating care across providers. In education, they might function as personalized tutors adapting to individual learning styles and progress. In professional services, they could become specialized research assistants that dramatically amplify human expertise.

However, these capabilities will also bring new challenges. More powerful systems will require more sophisticated safety mechanisms. Increasingly human-like interactions will raise new questions about appropriate disclosure of AI identity. And as these systems become more integrated into daily life, ensuring equitable access and preventing harmful dependencies will become important social considerations.

What seems clear is that the line between chatbots and other software interfaces will continue to blur. Natural language is simply the most intuitive interface for many human needs, and as conversational AI becomes more capable, it will increasingly become the default way we interact with digital systems. The future isn't just about better chatbots – it's about conversation becoming the primary human-computer interface for many applications.

Concluzie: Conversația în curs

Această arhitectură complexă permite experiențe care ar fi părut science fiction acum doar un deceniu - conversații naturale cu sisteme digitale care pot răspunde la întrebări, pot rezolva probleme și pot efectua acțiuni în numele nostru. Și totuși, suntem încă în primele capitole ale dezvoltării acestei tehnologii. Capacitățile și aplicațiile IA conversațională vor continua să se extindă rapid în următorii ani.

Pentru companiile și organizațiile care doresc să implementeze tehnologia chatbot, înțelegerea acestor componente de bază este crucială pentru stabilirea unor așteptări realiste, luarea unor decizii de design informate și crearea unor experiențe cu adevărat valoroase pentru utilizatori. Cele mai reușite implementări nu tratează chatboții ca pe niște cutii negre magice, ci mai degrabă ca pe niște instrumente sofisticate ale căror capacități și limitări trebuie gestionate cu atenție.

Pentru utilizatorii care interacționează cu aceste sisteme, o privire în spatele cortinei poate ajuta la demitizarea a ceea ce uneori pare a fi magie tehnologică. Înțelegerea principiilor de bază ale modului în care funcționează chatboții moderni permite o interacțiune mai eficientă – știind când pot ajuta, când ar putea avea dificultăți și cum să comunicăm cu ei cu cel mai mare succes.

Ceea ce este probabil cel mai remarcabil la tehnologia chatbot este cât de repede se adaptează așteptările noastre. Caracteristici care ne-ar fi uimit acum câțiva ani devin rapid punctul de referință pe care îl considerăm de la sine înțeles. Această normalizare rapidă vorbește despre modul în care conversația funcționează în mod natural ca o interfață – atunci când este făcută bine, pur și simplu dispare, lăsându-ne concentrați pe rezolvarea problemelor și pe realizarea lucrurilor, în loc să ne gândim la tehnologia în sine.

Pe măsură ce aceste sisteme continuă să evolueze, conversația dintre oameni și mașini va deveni din ce în ce mai fluidă și productivă – nu înlocuind conexiunea umană, ci sporindu-ne capacitățile și eliberându-ne pentru a ne concentra asupra aspectelor unice umane ale muncii și vieții noastre.